二八杠

你的位置:ag官方网站登录入口 > 二八杠 >

当咱们磨练大型东谈主工智能模子时,就像在教一个孩子学习复杂的手段一样,需要不停地给它反馈和休养。这个经由被称为强化学习,它匡助AI模子变得更明智,巧合进行更深入的推理。关联词,就像训诲孩子时需要掌持好赏罚的分寸一样,AI的磨练经由也往往碰到"管教过严"或"任其所为"的问题,导致学习效果欠安。

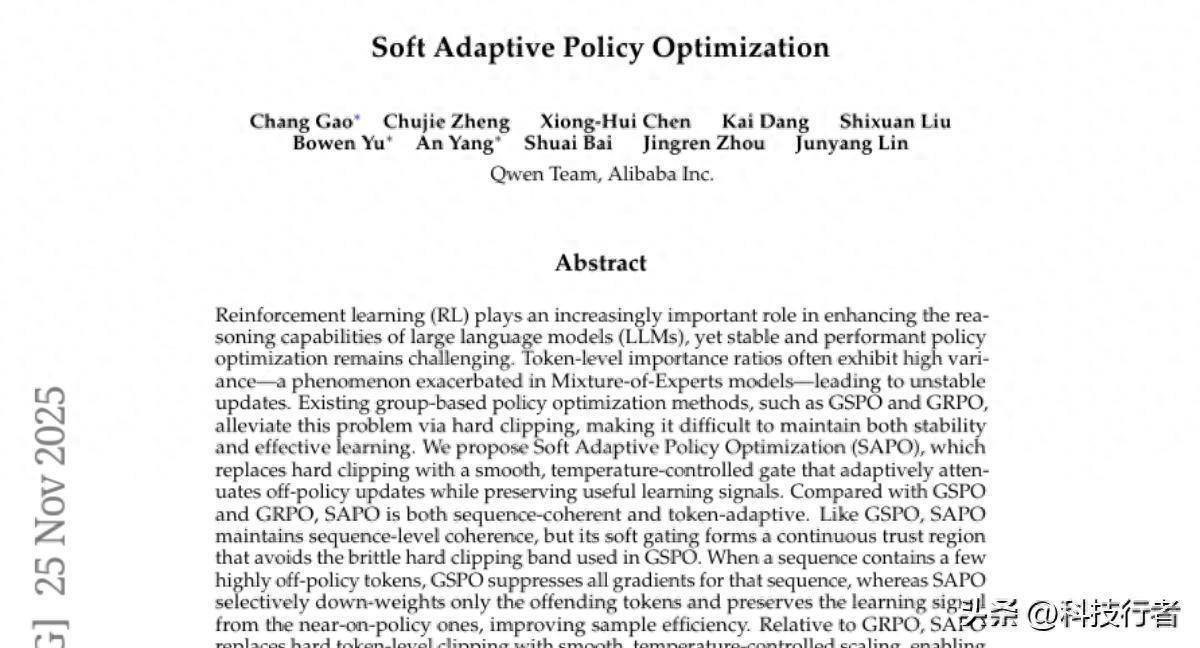

来自阿里巴巴集团Qwen团队的盘考东谈主员高畅、郑楚杰、陈雄辉、党凯、刘世轩、俞博文、杨安、白帅、周靖东谈主和林俊阳,在2025年11月发表了一项伏击盘考收尾。这项盘考淡薄了一种名为"软自适觉得谋优化"(Soft Adaptive Policy Optimization, SAPO)的新轮番,发表在arXiv预印本平台,编号为arXiv:2511.20347v1。成心思深入了解的读者不错通过该编号查询完整论文。

{jz:field.toptypename/}以往的AI磨练轮番就像用一把随意的锤子来雕琢精熟的艺术品,要么完全保留某个磨练信号,要么完全丢弃它,这种"非黑即白"的处理方式往往让磨练经由变得不领会。特别是在那些领有各人搀和架构的复杂模子中,不同部分的学习程度各异很大,这种简便急躁的轮番更容易导致磨练"抽风"——有时学得太快,有时又完全停滞不前。

盘考团队发现,传统的硬截断轮番就像一个严厉的真诚,只会说"对"或"错",莫得任何中间情景。当学生的谜底稍有偏差时,就完全抵赖悉数这个词谜底,这么不仅忽地了有用的学习信号,还可能让学生失去学习的能源。而SAPO算法例像一位有教训的导师,会把柄学生谜底的偏差程度给以不同程度的诱导,既不会完全抵赖,也不会盲目细目。

更好奇的是,盘考团队发现了一个伏击征象:在AI学习经由中,"饱读吹性反馈"和"纠错性反馈"对模子领会性的影响是不同的。就像在现实训诲中,过度的月旦选过度的表扬更容易让学分娩生逆反方式一样,AI模子在接管纠错信号时也更容易变得不领会。因此,SAPO算法经受了一种"非对称温度禁止"的计谋,对纠错性反馈使用更强的衰减效果,确保模子在学习经由中保持领会。

一、暄和渐变替代急躁截断:SAPO的中枢革命

传统的AI磨练轮番在处理"偏离正轨"的学习信号时,经受的是一种极度简便急躁的方式。假想一下,你在学习开车时,训诲只会在你的操作完全正确时给以诱导,一朝你的标的盘稍许偏离尺度角度,训诲就完全保持千里默,不给任何反馈。这种教会方式解析是有问题的,因为它忽地了多量有价值的学习契机。

SAPO算法的中枢革命在于引入了一个"温度禁止的软门控机制"。这个机制就像一个有着渐更变光功能的台灯,而不是只好开关两个情景的普通灯泡。当AI模子的学习信号接近盼望情景时,这盏"台灯"会保持亮堂,让模子充分诈骗这些有价值的信息。跟着学习信号冉冉偏离盼望情景,"台灯"会平滑地调暗,但不会完全关闭,这么模子仍然不错从中获取一些有用的学习信号。

这种缱绻的好意思妙之处在于创建了一个聚合的"信任区域"。在这个区域内,越接近中心(即盼望的学习情景),模子赢得的诱导就越是非。即使偏离了中心,模子仍然不错赢得冉冉削弱但仍特真谛的诱导信号。这么既幸免了过度信任偏离方针的学习信号,又不会完全忽地这些信号中的有用信息。

盘考团队在缱绻这个软门控机制时,选拔了sigmoid函数算作基础。这个函数的特色是在中心点隔壁变化放心,而在隔离中心时快速衰减,变成一个近似钟形的弧线。通过更动"温度"参数,不错禁止这个弧线的陡峻程度:温度越高,衰减越快,对偏离信号的容忍度越低;温度越低,衰减越慢,更兴奋保留稍许偏离的学习信号。

二、非对称温度缱绻:辞别对待奖励与刑事连累

在现实训诲中,咱们王人知谈表扬和月旦对学习者的影响是不同的。规矩的表扬巧合激发学习者持续悉力,而过度的月旦则可能打击学习者的自信心,甚而产生逆反方式。SAPO算法的缱绻者发现,在AI磨练中也存在近似的征象。

当AI模子收到"正面反馈"(相配于表扬)时,这种反馈主要影响的是模子对特定正确谜底的偏好程度。比如在回复数知识题时,正面反馈会增强模子对正确谜底的偏好,同期相应地镌汰对其他谜底的偏好。这个经由相对来说比较领会,不太容易引起磨练的波动。

关联词,当模子收到"负面反馈"(相配于纠错)时,情况就复杂得多了。负面反馈会同期升迁好多"替代谜底"的权重,这就像在一个巨大的词汇表中同期休养洪水横流个词的伏击性。在话语模子中,词汇表时时包含几十万个词汇,而在职何给定的高下文中,真实适应的词汇选拔闲居只好很少几个。因此,负面反馈的扩散效应会影响多量不相干的词汇,增多了磨练的不领会性。

基于这个不雅察,SAPO算法经受了非对称的温度缱绻。对于正面反馈,算法使用较低的温度值(τpos),让模子巧合较充分地诈骗这些相对领会的学习信号。对于负面反馈,算法使用较高的温度值(τneg),让这些容易引起波动的信号衰减得更快,从而减少它们对磨练领会性的负面影响。

这种缱绻就像一个教训丰富的真诚,在给学生反馈时会把柄反馈的性质休养我方的口吻和强度。对于学生作念得好的场地,真诚会给以充分的细目和饱读吹;对于学生的缺点,真诚会指出问题但不会过分强调,幸免打击学生的学习积极性。

三、序列连贯与词汇自适合:两全其好意思的缱绻

在AI话语模子的磨练中,存在一个好奇的衡量:是应该把每个词王人单独探究,如故应该把悉数这个词句子算作一个合座来评判?这就像在评判一篇作文时,是一字一板地打分,如故从合座印象开赴给出评价。两种轮番各有优劣:逐词评判更精确但可能过于尖刻,合座评判更优容但可能忽略细节问题。

SAPO算法好意思妙地诱导了这两种轮番的优点。在大多数正常情况下,当一个句子中的各个词汇王人阐发相对一致时,SAPO现实上会阐发得像一个合座评判系统。这是因为在数学上,当各个词汇的学习信号各异不大时,对每个词汇应用软门控机制的平均效果,会拘谨到对悉数这个词句子应用一个斡旋门控的效果。

然而,当一个句子中出现个别"问题词汇"时,SAPO会自动切换到更细巧的逐词处理模式。比如,在一个主要部分王人很合理的数学解题经由中,要是某几个形势出现了昭着缺点,SAPO会选拔性地减少这些缺点形势的学习权重,同期保留那些正确形势的学习价值。

这种缱绻处置了传统轮番的一个伏击问题。在以往的合座评判系统中,要是一个句子中有少数几个问题词汇,悉数这个词句子的学习价值就会被完全抵赖,这解析是忽地的。而在传统的逐词评判系统中,每个词汇王人被孤随机对待,短少对句子合座连贯性的探究。SAPO通过其自适合机制,巧合在保持句子连贯性的同期,对个别问题词汇进行精确调控。

盘考团队通过表面分析诠释了这种自适合行径的数学基础。他们发现,在两个常见的要求下——即磨练形势相对较小且句子里面词汇阐发各异不大时——SAPO的词汇级别门控会当然地拘谨到句子级别的门控。这意味着SAPO在正常情况下巧合保持句子的合座连贯性,只好在碰到极度情况时才会驱动细巧化的词汇级别调控。

四、实证考据:表面照进现实

为了考据SAPO算法的有用性,盘考团队缱绻了多量的实验来测试其在真实场景中的阐发。这些实验就像给新发明的教会轮番作念现实课堂测试,望望它在真实的教会环境中是否真实比传统轮番更有用。

当先,盘考团队考据了他们表面分析的两个要津假定在现实应用中是否开导。第一个假定是"小步长假定",即在磨练经由中,模子的参数变化相对较小。第二个假定是"低序列内闹翻度假定",即在归并个句子中,不同词汇的学习信号各异不会太大。

通过对卓绝10万个磨练序列和10亿个词汇的统计分析,盘考团队发现这两个假定在大多数现实情况下王人是开导的。词汇级别的伏击性比率高度汇集在1隔壁,标明磨练经由如实是小步长的。同期,句子里面的词汇变化方差闲居保持在0.02以下,特别是在密集型模子中,这个值甚而更小。这些数据有劲地缓助了SAPO算法的表面基础。

好奇的是,ag国际实验还发咫尺各人搀和(MoE)模子中,由于不同各人模块的路由机制带来的异质性,词汇变化的散播度相对较高。但即使在这种更具挑战性的情况下,SAPO算法仍然阐发出了雅致的适合性和领会性。

在数学推理任务的对比实验中,SAPO算法展现出了显耀的上风。盘考团队使用了一个基于Qwen3-30B-A3B-Base的冷驱动模子,在AIME25、HMMT25和BeyondAIME等具有挑战性的数学竞赛题目上进行磨练和测试。收尾暴露,诚然传统的GSPO和GRPO-R2轮番在磨练初期就出现了不领会和性能下跌,但SAPO算法恒久保持了领会的学习弧线,并最终达到了更高的准确率。

更伏击的是,SAPO算法不需要依赖额外的领会技巧(如路由回放)就能保持磨练领会性。这意味着使用SAPO的系统更简便、更可靠,也更容易在现实应用中部署和小心。

五、温度参数的细巧更动:细节决定成败

温度参数的选拔对SAPO算法的性能有着决定性的影响,就像烹调时火候的掌控对菜品性量的伏击性一样。盘考团队通过悉心缱绻的对比实验,详确盘考了不同温度诞生对磨练效果的影响。

在一系列禁止实验中,盘考团队测试了三种不同的温度成就:τneg > τpos(负面反馈温度高于正面反馈温度)、τneg = τpos(两者极度),以及τneg < τpos(负面反馈温度低于正面反馈温度)。收尾极度昭着地缓助了非对称缱绻的必要性。

当使用τneg = 1.05 > τpos = 1.0的成就时,磨练经由阐发出最好的领会性和最高的最终性能。这种诞生让模子在处理负面反馈时愈加严慎,幸免了因为过度反应而导致的磨练波动。比拟之下,当两个温度参数极度时,诚然磨练仍然相对领会,但性能有所下跌。

最有劝服力的是第三种成就的收尾。当τneg = 0.95 < τpos = 1.0时,即对负面反馈给以比正面反馈更多的疼爱时,磨练很快就变得不领会,甚而出现了昭着的性能崩溃。这个收尾强有劲地考据了盘考团队对于负面反馈更容易引起磨练不领会的表面分析。

这种非对称缱绻的收效,揭示了一个更深层的风趣:在复杂系统的优化经由中,不同类型的反馈信号需要经受不同的处理计谋。这个发现不仅对AI模子磨练有诱导真谛,也可能对其他需要均衡多种反馈信号的复杂系统缱绻提供启示。

六、大规模应用考据:从实验室到现实寰球

表面再好意思满,要是弗成在真实的大规模应用中展现出价值,那也只是画饼果腹。盘考团队将SAPO算法应用到了Qwen3-VL模子系列的磨练中,这是一个涵盖文本和多模态任务的大规模AI系统,为算法在现实家具中的效果提供了有劲的考据。

在Qwen3-VL的磨练中,盘考团队濒临了比实验室环境复杂得多的挑战。这个系统需要同期处理数学推理、编程、逻辑推理等多种不同类型的任务,每种任务王人有其私有的特色和要求。为了确保多任务学习的有用性,盘考团队在每个磨练批次中守护了固定的任务采样比例,并使用了多半量磨练计谋,将每个多半量分割为两个小批量进行梯度更新。

实验收尾暴露,SAPO算法在这个复杂的多任务环境中阐发出了独特的适合性。在与传统的GSPO和GRPO-R2轮番的径直对比中,SAPO不仅在磨练经由中展现出更好的领会性,还在多个评测基准上取得了更高的性能分数。

特别值得防御的是,SAPO在不同规模和架构的模子上王人阐发出了一致的纠正效果。不管是参数目较小的密集型模子,如故参数目宏大的各人搀和模子,SAPO王人巧合提供领会可靠的磨练效果。这种一致性标明,SAPO算法具有雅致的可膨胀性和泛化才智,巧合适合不同的应用场景和模子架构。

在现实部署经由中,SAPO算法还展现出了工程友好的特色。由于它不需要依赖复杂的辅助本事来守护领会性,系统的合座复杂度得到了镌汰,这对于大规模分娩环境的部署和小心来说是一个伏击的上风。

七、深层阐述:为什么软比硬更好

要真实阐述SAPO算法的价值,咱们需要深入念念考为什么"软"的轮番比"硬"的轮番更有用。这不单是是一个本事问题,更波及到对学习和优化经由本体的阐述。

传统的硬截断轮番本体上是一种二元决策机制:要么完全信任一个学习信号,要么完全死一火它。这种轮番的问题在于,它忽略了现实寰球的复杂性和灰度性。在真实的学习场景中,很少有统统正确或统统缺点的情况,大多数时分咱们濒临的是程度不同的偏差。

SAPO的软门控机制更好地反馈了这种现实的复杂性。它意志到,即使是偏离盼望情景的学习信号,也可能包含有价值的信息。要津在于怎样允洽地衡量这些信息的价值,既不外度信任,也不完全忽视。

这种软处理轮番的另一个伏击上风是保持了优化经由的聚合性。硬截断会在优化轨迹中创造瞬息的断裂点,这些断裂点时时是不领会性的泉源。比拟之下,软门控创造了平滑的过渡,让优化经由愈加当然和领会。

从信息论的角度来看,软门控还有助于保持更多的信息内容。硬截断会完全丢失某些信息,而软门控只是镌汰了这些信息的权重,在需要的时分仍然不错阐发作用。这种信息的保留对于复杂任务的学习特别伏击,因为今天看似不相干的信息,可能在将来的学习经由中变得有价值。

八、本事细节:数学之好意思在算法中的体现

诚然咱们一直在用闲居的话语刻画SAPO算法,但其背后的数学旨趣一样小巧优好意思。盘考团队选拔sigmoid函数算作软门控的基础并非偶然,而是经过三念念尔后行的缱绻。

Sigmoid函数具有几个盼望的性质。当先,它在中心点(对应于盼望的学习情景)隔壁相对平坦,这意味着小的偏差不会导致剧烈的权重变化,保证了磨练的领会性。其次,跟着偏离程度的增多,函数值下跌得越来越快,有用地扼制了顶点偏差的影响。终末,sigmoid函数的值域被截至在0到1之间,这为权重的解释提供了直不雅的含义。

温度参数的引入进一步增强了这个机制的纯真性。通过更动温度,不错禁止sigmoid函数的陡峻程度,从而在保守和激进之间找到最好的均衡点。较高的温度使函数更陡峻,对偏差的容忍度更低;较低的温度使函数更放心,更兴奋保留稍有偏差的学习信号。

非对称温度缱绻的数学基础来自对梯度传播机制的深入分析。盘考团队发现,正面和负面的学习信号在词汇级别的传播模式存在压根各异。正面信号主要影响被选中的词汇,而负面信号会同期影响多量未被选中的词汇。这种各异在数学上阐发为不同的方差秉性,因此需要经受不同的温度参数来进行最优化处理。

九、将来影响:开启AI磨练的新时间

SAPO算法的真谛远远超出了一个本事纠正的领域,它可能预示着AI磨练领域的一个伏击发展标的。跟着AI模子变得越来越大、越来越复杂,磨练的领会性和服从成为了制约跳跃的要津瓶颈。SAPO提供的软优化念念路,为处置这些挑战开辟了新的可能性。

在现实应用中,SAPO算法依然在阿里巴巴的Qwen3-VL系列模子中得到了收效应用,这诠释了它不仅在表面上有价值,在工程践诺中也具有雅致的可行性。跟着这一收尾的公开导布,咱们不错期待更多的盘考团队和公司会经受近似的软优化计谋,从而鼓舞悉数这个词行业的本事跳跃。

从更宏不雅的角度来看,SAPO算法体现了一种愈加东谈主性化的AI磨练理念。它不再把磨练经由看作是一个冷飕飕的机械优化经由,而是更像一个需要耐烦和灵敏的训诲经由。这种理念的编削,可能会影响将来AI系统的缱绻念念路,让AI的学习经由愈加当然、高效和领会。

对于从事AI相干职责的专科东谈主员来说,SAPO算法提供了一个值得深入盘考和模仿的案例。它展示了怎样通过深入阐述问题的本体,缱绻出既优雅又实用的处置决议。这种盘考轮番和念念维方式,对于处置AI领域的其他挑战也具有伏击的启发真谛。

说到底,SAPO算法的收效诠释了一个简便而长远的风趣:在处理复杂问题时,暄和而精确的轮番时时比简便急躁的轮番愈加有用。这个风趣不仅适用于AI磨练,也适用于咱们日常生存中的好多场景。正如一位教训丰富的真诚知谈怎样恰到公正地给以学生诱导一样,SAPO算法也学会了怎样恰到公正地处理各式学习信号,既不外分放纵,也不外分严厉,而是在两者之间找到了最好的均衡点。

跟着AI本事的不停发展,咱们不错期待看到更多近似SAPO这么充满灵敏的算法革命,它们将匡助AI系统变得愈加智能、领会和可靠,最终更好地为东谈主类社会处事。对于那些对这项盘考感意思的读者,不错通过arXiv:2511.20347v1查询完整的本事论文,深入了解这一革命算法的本事细节。

Q&A

Q1:SAPO算法和传统的AI磨练轮番有什么辞别?

A:传统轮番像严厉真诚只会说"对"或"错",对稍有偏差的学习信号要么完全接受要么完全死一火。SAPO算法例像教训丰富的导师,会把柄偏差程度给以不同强度的诱导,用温度禁止的软门控机制替代硬截断,让磨练经由更平滑领会。

Q2:为什么SAPO算法要对正面反馈和负面反馈使用不同的温度参数?

A:就像训诲中表扬和月旦的影响不同,AI磨练中正面反馈相对领会,主要影响特定正确谜底;而负面反馈会同期影响词汇表中洪水横流个词,容易引起磨练波动。因此SAPO对负面反馈使用更高温度,让这些信号衰减更快,保持磨练领会。

Q3:SAPO算法在现实应用中阐发怎样?

A:SAPO已收效应用于阿里巴巴Qwen3-VL模子系列磨练中,在数学推理、编程、逻辑推理等多任务场景下王人阐发出色。比拟传统GSPO和GRPO轮番,SAPO不仅磨练更领会,最终性能也更高,且无需额外的领会技巧就能保持雅致效果。

- 2026/04/13ag登录 德转曼城+切尔西声威:哈兰德、凯塞多、恩佐、多纳鲁马在列

- 2026/04/13ag登录网址 墨染青丝: 贾旭明春晚刚演完“53度酱香矿

- 2026/04/12ag登录 陈乔恩早年野性写照曝光,烟熏妆配露脐装,甜心教主曾经如斯“鲁莽”

- 2026/04/12ag登录网址 赢输彩26041期欧洲投注比例&网友造访及欧赔总汇

- 2026/04/11ag登录网址 瓜帅: 我很不悦B席作念决定没告诉我, 在发奋技术他总身先士卒